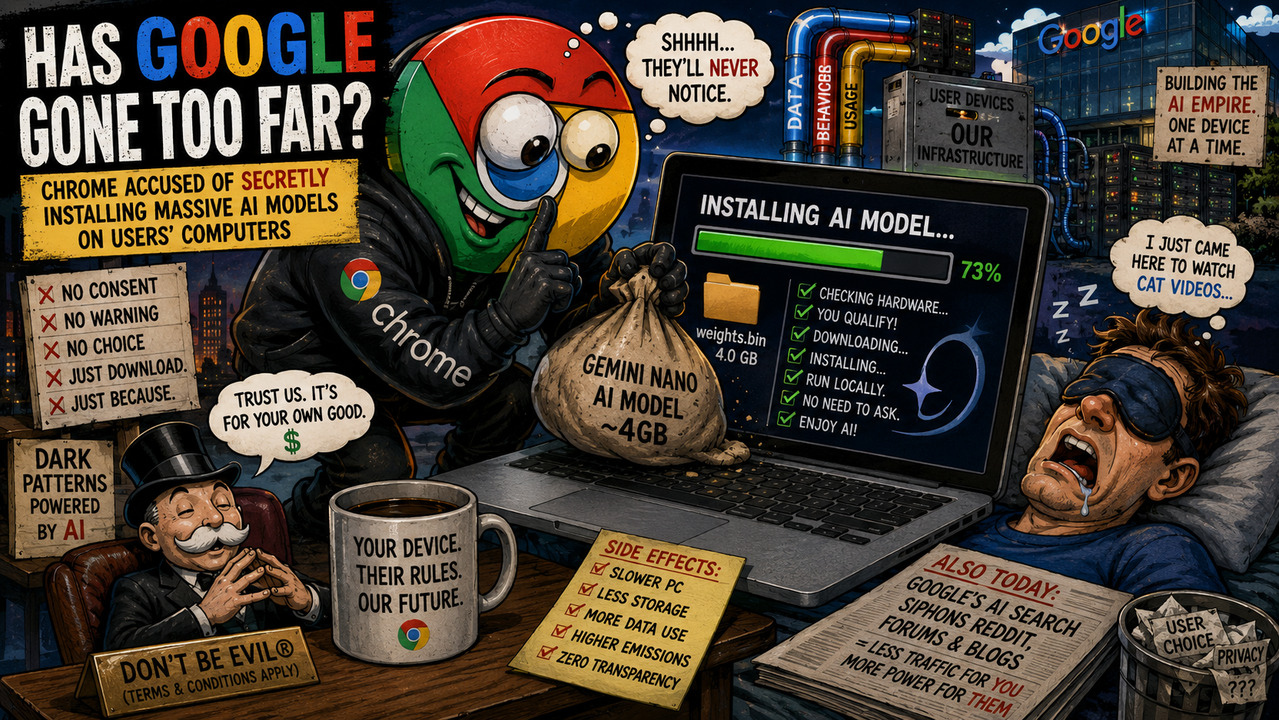

Hat Google zu weit gegangen? Chrome wird beschuldigt, heimlich massive KI-Modelle auf den Computern der Nutzer zu installieren.

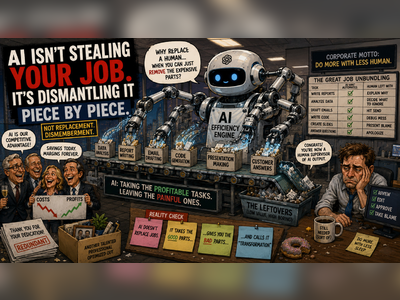

Seit Jahren versprechen die größten Technologieunternehmen der Welt, dass Künstliche Intelligenz unsere Geräte intelligenter, schneller und persönlicher machen wird. Was sie jedoch selten thematisierten, war, wie still diese Transformation geschehen würde – oder wie wenig Kontrolle die Nutzer letztendlich über die Maschinen behalten könnten, die sie angeblich besitzen.

Jetzt tritt ein wachsender Widerstand gegen die Behauptungen auf, dass Googles Chrome-Browser begonnen hat, ohne klare Zustimmung, ausdrückliche Genehmigung oder auch nur offensichtliche Benachrichtigung große KI-Modelle automatisch auf die Computer der Nutzer herunterzuladen. Diese Kontroversen haben eine tiefere und zunehmend unangenehme Frage neu entfacht, die im Zentrum der KI-Revolution steht: Wann genau hörten die Verbraucher auf, gefragt zu werden, bevor ihre Computer umfunktioniert wurden, um die Ambitionen des Silicon Valley zu unterstützen?

Die Vorwürfe stammen von dem Sicherheitsforscher Alexander Hanff, der online weithin als „That Privacy Guy“ bekannt ist und eine detaillierte technische Analyse veröffentlicht hat, die behauptet, dass Chrome stillschweigend ein lokales KI-Modell herunterlädt, das mit Googles Gemini-Nano-System verknüpft ist. Laut Hanff kann die Datei — angeblich weights.bin genannt — eine Größe von etwa vier Gigabyte erreichen und wird automatisch auf Maschinen installiert, die bestimmte Hardwareanforderungen erfüllen.

Vier Gigabyte sind kein triviales Hintergrund-Update. Bis vor kurzem wurde dieser Verbrauch an Speicherplatz mit großen Softwarepaketen oder modernen Videospielen in Verbindung gebracht, nicht mit einem Webbrowser, der hauptsächlich zum Öffnen von Tabs und zum Streamen von Videos verwendet wird. Dennoch behauptet Hanff, dass der Prozess unsichtbar im Hintergrund während gewöhnlicher Browsersitzungen abläuft, ohne bedeutende Offenlegung und ohne einen klaren Opt-in-Mechanismus.

Noch alarmierender ist, dass die Installation persistent ist. Nutzer, die die Datei manuell finden und löschen, könnten später entdecken, dass sie nach weiteren Aktivitäten in Chrome stillschweigend wieder auftaucht. Seinen Erkenntnissen zufolge kann es erforderlich sein, bestimmte Funktionen des Browsers tief in den Einstellungen von Chrome zu deaktivieren oder den Browser insgesamt zu entfernen, um den Download vollständig zu verhindern.

Um seine Behauptungen zu testen, führte Hanff ein, wie er es beschreibt, kontrolliertes Experiment auf macOS mit einem völlig neuen Chrome-Profil durch. Indem er das Journaling-Dateisystem des Betriebssystems überwachte — ein unabhängiger Protokollmechanismus, der Dateiaktivitäten unabhängig von anwendungsbezogenen Berichten aufzeichnet — beobachtete er, wie Chrome Verzeichnisse erstellte, die mit der KI-Infrastruktur verknüpft sind, und das Modell im Hintergrund über einen Zeitraum von etwa vierzehn Minuten herunterlud.

Der Browser, so behauptet er, bewertete zunächst die Hardwarefähigkeiten des Geräts, bevor entschieden wurde, ob es für das Ausführen eines lokalen KI-Modells geeignet ist. Praktisch gesehen wartete Chrome angeblich nicht darauf, dass die Nutzer KI-Tools aktivieren. Stattdessen wurde proaktiv bestimmt, welche Computer vor Ort KI unterstützen können, und die notwendige Infrastruktur wurde automatisch bereitgestellt.

Die Implikationen gehen weit über ein einzelnes Browser-Update hinaus.

Im Zentrum der Kontroversen steht eine umfassendere Transformation, die die Technologiebranche erfasst: die Migration künstlicher Intelligenz von entfernten Cloud-Servern direkt auf persönliche Geräte. Unternehmen argumentieren, dass lokale KI-Modelle die Geschwindigkeit verbessern, Serverkosten senken, den Datenschutz stärken und die Abhängigkeit von einer dauerhaften Internetverbindung verringern. Googles Gemini-Nano-Initiative ist speziell für diese Zukunft konzipiert — leichte KI-Systeme, die direkt auf Telefonen und Computern ohne ständige Kommunikation mit zentralen Rechenzentren agieren können.

Aus einer ingenieurtechnischen Perspektive ist die Logik überzeugend. Aus einer Perspektive der Benutzerrechte sagen Kritiker jedoch, dass die Ausführung äußerst bedenklich ist.

Hanff argumentiert, dass es sich bei dem Thema nicht nur um technische, sondern auch um philosophische Aspekte handelt. Seiner Ansicht nach behandeln Unternehmen zunehmend Verbrauchgeräte als Zielobjekte für den Einsatz, anstatt als privat kontrolliertes Eigentum. Funktionen werden standardmäßig aktiviert. Hintergrundprozesse operieren geräuschlos. Opt-out-Systeme sind in obskuren Menüs verborgen. Und zunehmend entdecken Nutzer wesentliche Änderungen erst, nachdem unabhängige Forscher sie aufgedeckt haben.

Die Kritik erinnert an jahrelange Beschwerden über sogenannte „Dark Patterns“ — Interface-Designs, die absichtlich darauf ausgelegt sind, das Benutzerverhalten zu manipulieren, wichtige Informationen zu verschleiern oder das Abmelden von Datenerfassung und Funktionsaktivierung zu erschweren. Datenschützer sagen, dass die Ära der KI das Risiko birgt, diese Praktiken massiv zu verstärken, indem umfangreiche Infrastrukturen für maschinelles Lernen direkt in die Hardware der Verbraucher eingebettet werden, unter dem Vorwand nahtloser Bequemlichkeit.

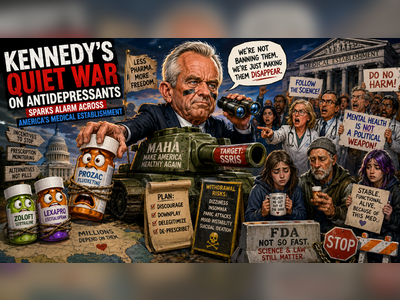

Die rechtlichen Implikationen könnten ebenfalls explosiv sein.

Hanff argumentiert, dass die stillschweigende Bereitstellung von KI möglicherweise im Widerspruch zu europäischen Datenschutzrahmenbedingungen wie der Datenschutz-Grundverordnung und der ePrivacy-Richtlinie steht, die beide strenge Regeln bezüglich der Zustimmung der Nutzer, Transparenz und der Speicherung auf lokalen Geräten auferlegen. Europäische Regulierungsbehörden haben wiederholt gezeigt, dass sie bereit sind, große Technologieunternehmen wegen versteckter Nachverfolgungssysteme, aggressiver Datenpraktiken und intransparenter Zustimmungsflüsse zur Verantwortung zu ziehen. Sollten die Regulierungsbehörden feststellen, dass stille KI-Installationen gegen bestehende Datenschutzgesetze verstoßen, könnten die Folgen für die Branche enorm sein.

Für den Moment bleiben die Behauptungen Vorwürfe von unabhängigen Forschern und wurden noch nicht vor Gericht getestet. Doch die Kontroversen tauchen zu einem Zeitpunkt auf, an dem das öffentliche Vertrauen in große Technologieunternehmen bereits aufgrund der ständigen Expansion der KI bröckelt.

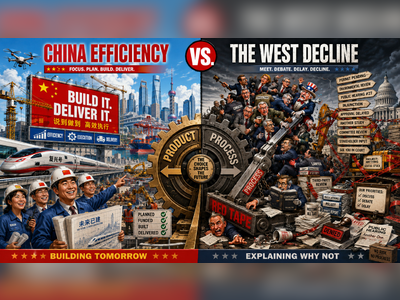

Über den Datenschutz hinaus hebt Hanff auch eine weniger diskutierte Folge der lokalen KI-Bereitstellung hervor: die Belastung der Infrastruktur.

Für Nutzer in wohlhabenden städtischen Märkten, die mit unbegrenzten Glasfasernetzen verbunden sind, mag ein vier Gigabyte großes Hintergrund-Download unbedeutend erscheinen. Aber Hunderte Millionen Menschen weltweit arbeiten weiterhin mit gedrosselten Internet-Tarifen, mobilen Hotspots, instabiler Infrastruktur oder teuren Bandbreitenbeschränkungen. Ein Browser, der stillschweigend Gigabytes von Daten verbraucht, kann in echte finanzielle Kosten umschlagen.

Dann gibt es die Umweltfrage.

Hanff schätzt, dass, wenn ähnliche Modelle auf Hunderten Millionen Geräten weltweit verteilt werden, der bloße Transfer dieser Dateien Zehntausende Tonnen an Kohlenstoffemissionen erzeugen könnte, bevor ein einziges KI-Feature jemals aktiv benutzt wird. Zu einer Zeit, in der Technologieunternehmen aggressiv Nachhaltigkeitsversprechen und kohlenstoffneutrale Ambitionen vermarkten, sagen Kritiker, dass massenweise unsichtbare Downloads einen wachsenden Widerspruch zwischen der Umweltmarke der Unternehmen und der Ressourcenintensität der KI-Expansion offenbaren.

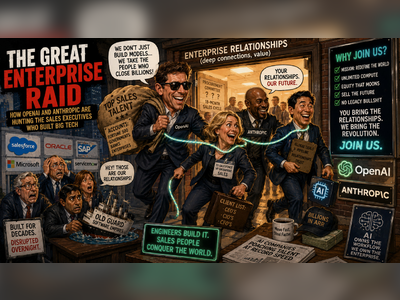

Gleichzeitig gestaltet Google ein weiteres Grundpfeiler des Internets: die Suche selbst.

Neben der Chrome-Kontroverse kündigte das Unternehmen an, dass seine KI-gestützten Suchsysteme — einschließlich KI-Übersichten und KI-Modus — zunehmend Antworten integrieren werden, die aus Reddit-Diskussionen, Fachforen, persönlichen Blogs und sozialen Medien stammen.

Der Wandel spiegelt eine tiefgreifende Veränderung darin wider, wie Menschen online nach Informationen suchen. In den letzten Jahren haben Nutzer zunehmend das Wort „Reddit“ an gewöhnliche Google-Suchen angehängt, getrieben von der Frustration, dass traditionelle Suchergebnisse mit suchmaschinenoptimierten Marketinginhalten, Affiliate-Spam und generischen Artikeln übersättigt sind, die primär für Werbeeinnahmen statt für Nützlichkeit erstellt wurden.

Die Antwort von Google ist im Grunde ein Eingeständnis, dass die wertvollsten Informationen im Internet jetzt weniger in polierten Unternehmenswebsites und mehr in chaotischen öffentlichen Diskussionen zwischen gewöhnlichen Nutzern zu finden sein könnten.

Im Rahmen des neuen Systems plant Google, einen Abschnitt mit der Bezeichnung „Expertenrat“ einzuführen, in dem Kommentare, Benutzernamen, Diskussionen der Gemeinschaft und Forenantworten direkt in KI-generierten Suchergebnissen angezeigt werden. Das Unternehmen wird außerdem mehr Links in KI-Zusammenfassungen integrieren und längere Lesematerialien empfehlen, die mit der Anfrage verbunden sind.

Auf den ersten Blick scheint die Strategie praktisch. Echte menschliche Gespräche bieten oft reichhaltigere, ehrlichere Antworten als sterile SEO-Inhaltsfarmen. Doch der Schritt offenbart auch eine weitere unbequeme Realität für Verlage und unabhängige Websites: Da Googles KI zunehmend in der Lage ist, Informationen direkt in Suchergebnisse zu synthetisieren, könnte es weniger Nutzern ein Bedürfnis erscheinen, originale Websites überhaupt zu besuchen.

Die Internetwirtschaft wurde auf Traffic aufgebaut. KI-Suche droht, dieses Ökosystem durch Extraktion zu ersetzen.

Was aus beiden Kontroversen hervorgeht — der stillen KI-Bereitstellung in Chrome und der KI-generierten Suche, die aus Community-Inhalten aufgebaut ist — ist ein Bild einer Branche, die mit atemberaubender Geschwindigkeit voranschreitet, während die öffentliche Aufsicht Mühe hat, Schritt zu halten. Dieselben Unternehmen, die einst Werkzeuge zur Verfügung stellten, um Nutzern die Navigation im Internet zu erleichtern, gestalten jetzt die Architektur von Informationen, Informatik und sogar persönlichen Geräten selbst um.

Und zunehmend scheinen sie bereit zu sein, es zuerst zu tun — und es später zu erklären.

Die Vorwürfe stammen von dem Sicherheitsforscher Alexander Hanff, der online weithin als „That Privacy Guy“ bekannt ist und eine detaillierte technische Analyse veröffentlicht hat, die behauptet, dass Chrome stillschweigend ein lokales KI-Modell herunterlädt, das mit Googles Gemini-Nano-System verknüpft ist. Laut Hanff kann die Datei — angeblich weights.bin genannt — eine Größe von etwa vier Gigabyte erreichen und wird automatisch auf Maschinen installiert, die bestimmte Hardwareanforderungen erfüllen.

Vier Gigabyte sind kein triviales Hintergrund-Update. Bis vor kurzem wurde dieser Verbrauch an Speicherplatz mit großen Softwarepaketen oder modernen Videospielen in Verbindung gebracht, nicht mit einem Webbrowser, der hauptsächlich zum Öffnen von Tabs und zum Streamen von Videos verwendet wird. Dennoch behauptet Hanff, dass der Prozess unsichtbar im Hintergrund während gewöhnlicher Browsersitzungen abläuft, ohne bedeutende Offenlegung und ohne einen klaren Opt-in-Mechanismus.

Noch alarmierender ist, dass die Installation persistent ist. Nutzer, die die Datei manuell finden und löschen, könnten später entdecken, dass sie nach weiteren Aktivitäten in Chrome stillschweigend wieder auftaucht. Seinen Erkenntnissen zufolge kann es erforderlich sein, bestimmte Funktionen des Browsers tief in den Einstellungen von Chrome zu deaktivieren oder den Browser insgesamt zu entfernen, um den Download vollständig zu verhindern.

Um seine Behauptungen zu testen, führte Hanff ein, wie er es beschreibt, kontrolliertes Experiment auf macOS mit einem völlig neuen Chrome-Profil durch. Indem er das Journaling-Dateisystem des Betriebssystems überwachte — ein unabhängiger Protokollmechanismus, der Dateiaktivitäten unabhängig von anwendungsbezogenen Berichten aufzeichnet — beobachtete er, wie Chrome Verzeichnisse erstellte, die mit der KI-Infrastruktur verknüpft sind, und das Modell im Hintergrund über einen Zeitraum von etwa vierzehn Minuten herunterlud.

Der Browser, so behauptet er, bewertete zunächst die Hardwarefähigkeiten des Geräts, bevor entschieden wurde, ob es für das Ausführen eines lokalen KI-Modells geeignet ist. Praktisch gesehen wartete Chrome angeblich nicht darauf, dass die Nutzer KI-Tools aktivieren. Stattdessen wurde proaktiv bestimmt, welche Computer vor Ort KI unterstützen können, und die notwendige Infrastruktur wurde automatisch bereitgestellt.

Die Implikationen gehen weit über ein einzelnes Browser-Update hinaus.

Im Zentrum der Kontroversen steht eine umfassendere Transformation, die die Technologiebranche erfasst: die Migration künstlicher Intelligenz von entfernten Cloud-Servern direkt auf persönliche Geräte. Unternehmen argumentieren, dass lokale KI-Modelle die Geschwindigkeit verbessern, Serverkosten senken, den Datenschutz stärken und die Abhängigkeit von einer dauerhaften Internetverbindung verringern. Googles Gemini-Nano-Initiative ist speziell für diese Zukunft konzipiert — leichte KI-Systeme, die direkt auf Telefonen und Computern ohne ständige Kommunikation mit zentralen Rechenzentren agieren können.

Aus einer ingenieurtechnischen Perspektive ist die Logik überzeugend. Aus einer Perspektive der Benutzerrechte sagen Kritiker jedoch, dass die Ausführung äußerst bedenklich ist.

Hanff argumentiert, dass es sich bei dem Thema nicht nur um technische, sondern auch um philosophische Aspekte handelt. Seiner Ansicht nach behandeln Unternehmen zunehmend Verbrauchgeräte als Zielobjekte für den Einsatz, anstatt als privat kontrolliertes Eigentum. Funktionen werden standardmäßig aktiviert. Hintergrundprozesse operieren geräuschlos. Opt-out-Systeme sind in obskuren Menüs verborgen. Und zunehmend entdecken Nutzer wesentliche Änderungen erst, nachdem unabhängige Forscher sie aufgedeckt haben.

Die Kritik erinnert an jahrelange Beschwerden über sogenannte „Dark Patterns“ — Interface-Designs, die absichtlich darauf ausgelegt sind, das Benutzerverhalten zu manipulieren, wichtige Informationen zu verschleiern oder das Abmelden von Datenerfassung und Funktionsaktivierung zu erschweren. Datenschützer sagen, dass die Ära der KI das Risiko birgt, diese Praktiken massiv zu verstärken, indem umfangreiche Infrastrukturen für maschinelles Lernen direkt in die Hardware der Verbraucher eingebettet werden, unter dem Vorwand nahtloser Bequemlichkeit.

Die rechtlichen Implikationen könnten ebenfalls explosiv sein.

Hanff argumentiert, dass die stillschweigende Bereitstellung von KI möglicherweise im Widerspruch zu europäischen Datenschutzrahmenbedingungen wie der Datenschutz-Grundverordnung und der ePrivacy-Richtlinie steht, die beide strenge Regeln bezüglich der Zustimmung der Nutzer, Transparenz und der Speicherung auf lokalen Geräten auferlegen. Europäische Regulierungsbehörden haben wiederholt gezeigt, dass sie bereit sind, große Technologieunternehmen wegen versteckter Nachverfolgungssysteme, aggressiver Datenpraktiken und intransparenter Zustimmungsflüsse zur Verantwortung zu ziehen. Sollten die Regulierungsbehörden feststellen, dass stille KI-Installationen gegen bestehende Datenschutzgesetze verstoßen, könnten die Folgen für die Branche enorm sein.

Für den Moment bleiben die Behauptungen Vorwürfe von unabhängigen Forschern und wurden noch nicht vor Gericht getestet. Doch die Kontroversen tauchen zu einem Zeitpunkt auf, an dem das öffentliche Vertrauen in große Technologieunternehmen bereits aufgrund der ständigen Expansion der KI bröckelt.

Über den Datenschutz hinaus hebt Hanff auch eine weniger diskutierte Folge der lokalen KI-Bereitstellung hervor: die Belastung der Infrastruktur.

Für Nutzer in wohlhabenden städtischen Märkten, die mit unbegrenzten Glasfasernetzen verbunden sind, mag ein vier Gigabyte großes Hintergrund-Download unbedeutend erscheinen. Aber Hunderte Millionen Menschen weltweit arbeiten weiterhin mit gedrosselten Internet-Tarifen, mobilen Hotspots, instabiler Infrastruktur oder teuren Bandbreitenbeschränkungen. Ein Browser, der stillschweigend Gigabytes von Daten verbraucht, kann in echte finanzielle Kosten umschlagen.

Dann gibt es die Umweltfrage.

Hanff schätzt, dass, wenn ähnliche Modelle auf Hunderten Millionen Geräten weltweit verteilt werden, der bloße Transfer dieser Dateien Zehntausende Tonnen an Kohlenstoffemissionen erzeugen könnte, bevor ein einziges KI-Feature jemals aktiv benutzt wird. Zu einer Zeit, in der Technologieunternehmen aggressiv Nachhaltigkeitsversprechen und kohlenstoffneutrale Ambitionen vermarkten, sagen Kritiker, dass massenweise unsichtbare Downloads einen wachsenden Widerspruch zwischen der Umweltmarke der Unternehmen und der Ressourcenintensität der KI-Expansion offenbaren.

Gleichzeitig gestaltet Google ein weiteres Grundpfeiler des Internets: die Suche selbst.

Neben der Chrome-Kontroverse kündigte das Unternehmen an, dass seine KI-gestützten Suchsysteme — einschließlich KI-Übersichten und KI-Modus — zunehmend Antworten integrieren werden, die aus Reddit-Diskussionen, Fachforen, persönlichen Blogs und sozialen Medien stammen.

Der Wandel spiegelt eine tiefgreifende Veränderung darin wider, wie Menschen online nach Informationen suchen. In den letzten Jahren haben Nutzer zunehmend das Wort „Reddit“ an gewöhnliche Google-Suchen angehängt, getrieben von der Frustration, dass traditionelle Suchergebnisse mit suchmaschinenoptimierten Marketinginhalten, Affiliate-Spam und generischen Artikeln übersättigt sind, die primär für Werbeeinnahmen statt für Nützlichkeit erstellt wurden.

Die Antwort von Google ist im Grunde ein Eingeständnis, dass die wertvollsten Informationen im Internet jetzt weniger in polierten Unternehmenswebsites und mehr in chaotischen öffentlichen Diskussionen zwischen gewöhnlichen Nutzern zu finden sein könnten.

Im Rahmen des neuen Systems plant Google, einen Abschnitt mit der Bezeichnung „Expertenrat“ einzuführen, in dem Kommentare, Benutzernamen, Diskussionen der Gemeinschaft und Forenantworten direkt in KI-generierten Suchergebnissen angezeigt werden. Das Unternehmen wird außerdem mehr Links in KI-Zusammenfassungen integrieren und längere Lesematerialien empfehlen, die mit der Anfrage verbunden sind.

Auf den ersten Blick scheint die Strategie praktisch. Echte menschliche Gespräche bieten oft reichhaltigere, ehrlichere Antworten als sterile SEO-Inhaltsfarmen. Doch der Schritt offenbart auch eine weitere unbequeme Realität für Verlage und unabhängige Websites: Da Googles KI zunehmend in der Lage ist, Informationen direkt in Suchergebnisse zu synthetisieren, könnte es weniger Nutzern ein Bedürfnis erscheinen, originale Websites überhaupt zu besuchen.

Die Internetwirtschaft wurde auf Traffic aufgebaut. KI-Suche droht, dieses Ökosystem durch Extraktion zu ersetzen.

Was aus beiden Kontroversen hervorgeht — der stillen KI-Bereitstellung in Chrome und der KI-generierten Suche, die aus Community-Inhalten aufgebaut ist — ist ein Bild einer Branche, die mit atemberaubender Geschwindigkeit voranschreitet, während die öffentliche Aufsicht Mühe hat, Schritt zu halten. Dieselben Unternehmen, die einst Werkzeuge zur Verfügung stellten, um Nutzern die Navigation im Internet zu erleichtern, gestalten jetzt die Architektur von Informationen, Informatik und sogar persönlichen Geräten selbst um.

Und zunehmend scheinen sie bereit zu sein, es zuerst zu tun — und es später zu erklären.

Translation:

Translated by AI

AI Disclaimer: An advanced artificial intelligence (AI) system generated the content of this page on its own. This innovative technology conducts extensive research from a variety of reliable sources, performs rigorous fact-checking and verification, cleans up and balances biased or manipulated content, and presents a minimal factual summary that is just enough yet essential for you to function as an informed and educated citizen. Please keep in mind, however, that this system is an evolving technology, and as a result, the article may contain accidental inaccuracies or errors. We urge you to help us improve our site by reporting any inaccuracies you find using the "Contact Us" link at the bottom of this page. Your helpful feedback helps us improve our system and deliver more precise content. When you find an article of interest here, please look for the full and extensive coverage of this topic in traditional news sources, as they are written by professional journalists that we try to support, not replace. We appreciate your understanding and assistance.